CogVideo(文字生成影片開源模型)簡介

CogVideo 是一個文字生成影片開源模型,由清華大學訊飛聯合實驗室推出。該專案目前開源了兩個影片生成模型:CogVideo(ICLR 2023) 和 CogVideoX 系列。該模型能夠根據文字輸入生成相對高幀率的影片。

CogVideo 是首個開源的預訓練文字到影片生成模型,能夠根據文字輸入生成相對高幀率的影片。

CogVideoX 則是 CogVideo 的升級版本,是清華訊飛實驗室在 2024 年開源的影片生成模型系列。目前已開源了 CogVideoX-2B 和 CogVideoX-5B 兩個模型,分別具有 20 億和 50 億參數。與 CogVideo 相比,CogVideoX 系列在生成影片品質和視覺效果方面有了大幅提升。

CogVideoX 系列在模型架構、訓練策略等多方面進行了創新,例如採用了 Diffusion Model、3D Casual VAE 等先進技術。該系列模型支援量化推理,能在較低算力設備上運行,且支援英語輸入和長文本輸入。

CogVideo(文字生成影片開源模型)官網

- 開源地址:https://github.com/THUDM/CogVideo

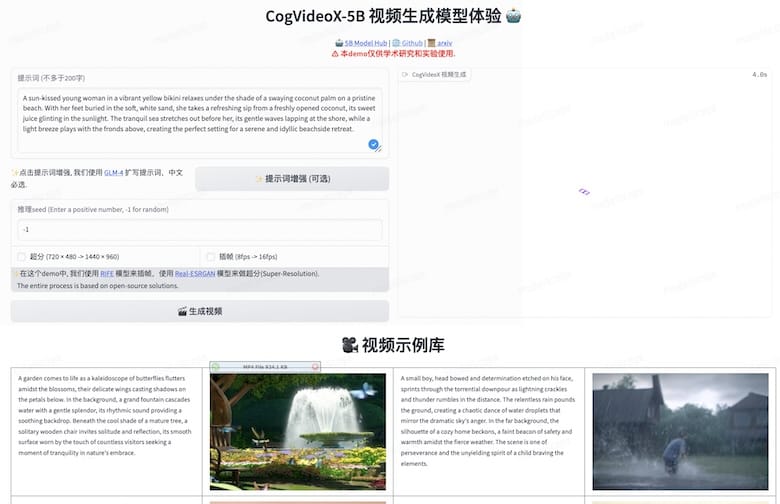

- 線上體驗地址 1:https://huggingface.co/spaces/THUDM/CogVideoX-5B-Space

- 線上體驗地址 2:https://modelscope.cn/studios/ZhipuAI/CogVideoX-5b-demo

提供了線上 Demo,打開線上 Demo 後可以輸入中文描述,體驗文字到影片生成效果。

正文完